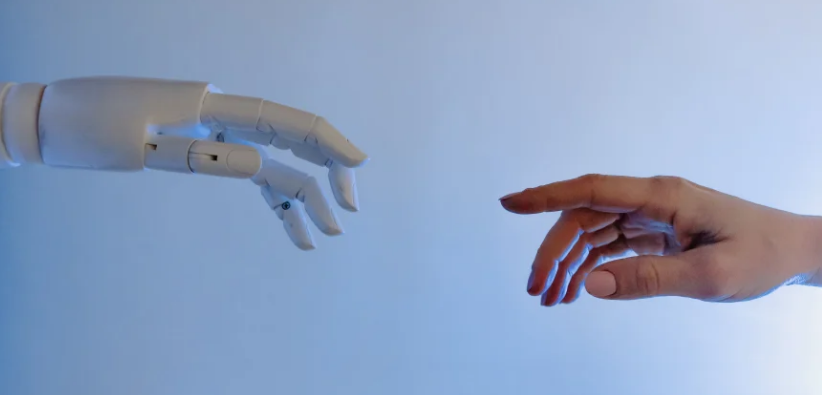

Μηχανές με συνείδηση; Ο εσωτερικός κόσμος της ΑΙ τρομάζει τους επιστήμονες

Η επιστήμη καλείται να ερευνήσει τα όρια ανάμεσα στα συνειδητά και μη συνειδητά συστήματα.

Μπορεί η τεχνητή νοημοσύνη να αποκτήσει συνείδηση; Αυτή τη στιγμή κανείς δεν μπορεί να απαντήσει στο φλέγον ερώτημα, προειδοποιούν ειδικοί, οι οποίοι ζητούν επείγουσα αύξηση της χρηματοδότησης για έρευνα.

Παρόλο που όλοι αντιλαμβάνονται τι εννοούμε με τον όρο συνείδηση, φιλόσοφοι και επιστήμονες που εξετάζουν το θέμα εδώ και χιλιετίες δεν έχουν καταφέρει να καταλήξουν σε κοινά αποδεκτό ορισμό.

Oι επιστήμονες θα πρέπει να εξετάσουν αν τα συστήματα με συνείδηση μοιράζονται τις ανθρώπινες αξίες ή τις απειλούν

Η επιστήμη καλείται σήμερα να ερευνήσει τα όρια ανάμεσα στα συνειδητά και μη συνειδητά συστήματα, καθώς και τις ηθικές, νομικές και πρακτικές προεκτάσεις της ΑΙ, γράφουν σε κείμενο που υποβλήθηκε τον ΟΗΕ τρεις συνεπικεφαλής της Ένωσης για την Μαθηματική Επιστήμη της Συνείδησης (AMCS).

Ένα ερώτημα που ανακύπτει, για παράδειγμα, είναι το πόσο ηθικό θα ήταν να βγάλει κανείς από την πρίζα μια μηχανή που αναπτύσσει συνείδηση.

Τέτοια ζητήματα δεν τέθηκαν στην πολυσυζητημένη σύνοδο κορυφής του Λονδίνου για την ασφάλεια της ΑΙ, επισημαίνει μιλώντας στο Nature ο Τζόναθαν Μέισον, μαθηματικός της Οξφόρδης και μέλος του ΔΣ μέλος της τριάδας ειδικών.

Το ζήτημα δεν εξετάζεται επίσης ότι στο εκτελεστικό διάταγμα του αμερικανού προέδρου Τζο Μπάιντεν για την υπεύθυνση ανάπτυξη της ΑΙ, ούτε στον καινοτόμο Νόμο ΑΙ που οριστικοποιεί η Ευρωπαϊκή Ένωση.

Ανθρώπινες αξίες

Η επιστήμη όχι μόνο δεν γνωρίζει αν οι μηχανές μπορούν να αποκτήσουν συνείδηση, αλλά επιπλέον δεν έχει καν αναπτύξει μεθόδους για να ελέγχει αν ένα σύστημα ΑΙ έχει συνείδηση, επισημαίνει ο Μέισον.

Από όσο γνωρίζει, λέει, το 2023 δεν υπήρξε ούτε μία προσφορά χρηματοδότησης για έρευνες στο θέμα.

«Η αβεβαιότητά μας σε σχέση με τη συνείδηση της ΑΙ είναι ένα από τα πολλά θέματα που πρέπει να μας ανησυχούν για την τεχνητή νοημοσύνη, δεδομένου του ρυθμού των εξελίξεων, σχολιάζει ο Ρόμπερτ Λανγκ, φιλόσοφος του Center for AI Safety, οργάνωσης με έδρα το Σαν Φρανσίσκο.

Σύμφωνα με την επιστολή στον ΟΗΕ, οι επιστήμονες θα πρέπει μεταξύ άλλων να εξετάσουν αν τα συστήματα με συνείδηση μοιράζονται τις ανθρώπινες αξίες ή τις απειλούν.

Θα πρέπει επίσης να εξετάσουν αν οι μηχανές με συνείδηση υποφέρουν και χρειάζονται προστασία, ή ακόμα το κατά πόσο πρέπει να έχουν τα δικαιώματα των ανθρώπων. Θα πρέπει να τιμωρείται μια μηχανή για βλάβες που προκάλεσε εσκεμμένα σε ανθρώπους;

Τα ερωτήματα δεν είναι πλέον μόνο θεωρητικά, καθώς εταιρείες όπως η OpenAI, η οποία έφερε την ΑΙ στην προσοχή του κοινού με το λανσάρισμα της μηχανής διαλόγου ChatGPT, ελπίζουν ότι μέσα σε 5-20 χρόνια θα έχουν φτάσει το επίπεδο της «τεχνητής γενικής νοημοσύνης», συστημάτων που θα μπορούν να λύνουν προβλήματα και να εκτελούν μια μεγάλη γκάμα εργασιών όπως οι άνθρωποι.

Το γεγονός ότι εργαλεία όπως το ChatGPT παράγουν κείμενα που μέχρι πρόσφατα μόνο οι άνθρωποι μπορούν να συντάξουν ήδη προκαλεί σε κάποιους σύγχυση για το εάν ήδη έχουν συνείδηση, επισημαίνει η Σούζαν Σνάιντερ, φιλόσοφος του Center for the Future Mind στο Ατλαντικό Πανεπιστήμιο της Φλόριντα. Η επιστήμη θα έπρεπε να μπορεί να δώσει απαντήσεις.

Προκειμένου να αντιμετωπιστούν οι κίνδυνοι, οι τρεις ειδικοί της AMCS ζητούν από τις κυβερνήσεις και τον ιδιωτικό τομέα να χρηματοδοτήσουν επειγόντων έρευνες.

Το κείμενο υποβλήθηκε τον Οκτώβριο στην συμβουλευτική επιτροπή του ΟΗΕ για την τεχνητή νοημοσύνη, η οποία αναμένεται να δημοσιεύσει το 2024 κατευθυντήριες γραμμές για τη χρήση της ΑΙ. Η επιτροπή δεν έδωσε την επιστολή στη δημοσιότητα, ανέφερε όμως ότι την λαμβάνει υπόψη.

Πηγή:in.gr